保罗·沙瑞尔:没有天定命运,人类主宰未来

来源:世界知识出版社(微信公众号) | 文/[美] 保罗·沙瑞尔 译/朱启超 王姝 龙坤 2019年07月26日07:00

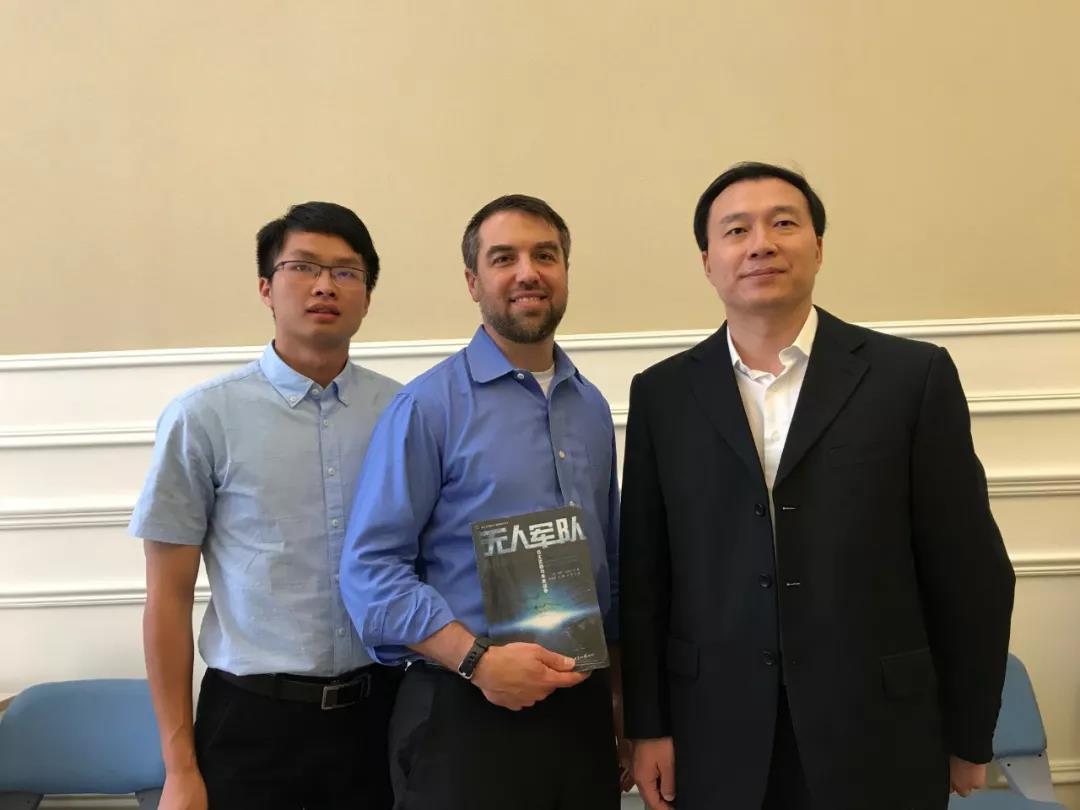

2019年6月25日在北京开会相聚的《无人军队》 译者朱启超、作者保罗·沙瑞尔、译者龙坤(从右至左)

*本文为保罗·沙瑞尔著作《无人军队:自主武器与未来战争》结语。

在系列科幻电影《终结者》中,萨拉•康纳和她后来成为人类反抗机器人组织领袖的儿子约翰,陷入了比机器人终结者更难摆脱的“敌人”的追杀——命运。

无论萨拉和约翰母子打败指挥终结者机器人的“天网”多少次,终结者机器人在下一部电影中仍会回来继续执行对人类的追杀令。

萨拉和约翰作为电影系列中的受害者出现,这种结构化叙事成了屡试不爽的票房保证,但他们陷入命运的魔咒也是很关键的叙事手法。

在《终结者》系列电影中,萨拉和约翰被来自未来的终结者杀手机器人一遍又一遍追杀,目的是阻止约翰成为对抗机器人的人类反抗组织领袖。

科幻电影的核心叙事逻辑是关于时光旅行悖论:如果终结者机器人成功杀死了萨拉和约翰,那么约翰也就无法成为人类反抗组织领袖,故事将无法铺展下去,因此不能一开始就把故事的主人公干掉。

同时,萨拉和约翰总是试图在“天网”完全建成之前就要捣毁它。这也就产生另一个悖论:如果萨拉母子成功了,“天网”系统就无法派出终结者杀手机器人去攻击人类,也就会让萨拉和约翰失去了继续与“天网”作战的理由。

萨拉和约翰的角色被设定了,他们永远处于穿过过去、现在和未来与“天网”的斗争中。

无论他们母子如何艰苦地斗争,“审判日”看上去总要到来,虽然这一天处于变化中(根据电影吸引观众的需要,每一部电影上线后,该部电影中的“审判日”却又总是设定在不远的未来,类似于且看下回分解)。

尽管如此,萨拉和约翰始终在与命运抗争,从未动摇他们永远战胜“天网”从而避免“审判日”到来的坚定信念。

在《终结者2:审判日》电影中,约翰•康纳引用了他妈妈的话:

“未来并没有被设定。没有天定的命运,而是人类要主宰自己的未来。”

这句话在后续的电影中也反复出现。

的确,萨拉•康纳是对的。在现实世界中,人类的未来并没有被设定。

本书中向读者展示了不同的未来图景——令人可怕的图景和美好的图景——只不过是人们的想象。真正的未来正随着时间推移一步一步展现。

技术会改变未来吗?当然,但技术是由人创造的。

以人工智能技术为例,就是在技术上得益于杜安尼•戴维斯、布拉德福德•托斯利和布兰登•曾那样的技术天才而不断改进,在政策上得益于拉里•许特、弗兰克•肯德尔和鲍勃•沃克等官员的持续支持而不断发展的,而这些官员关于发展人工智能技术的决策也受到斯图亚特•拉塞尔、乔迪•威廉姆斯和罗恩•阿尔金积极呼吁的影响。

上述的所有个体都有自己的选择。集体而言,人类也有人类自己的选择。

是否赋予机器自主决定其行动而不受人类判断和决策影响的技术,其实最终取决于人类。

将人工智能技术用于什么目的,最终也取决于人类自身。

比如,我们可以运用人工智能建立一个更加安全、更少痛苦、更少事故、更少暴行的世界,建议一个运行良好但保留人类在必要时施加干预的人工智能世界。我们可以打造一个充满更多同情与关爱、更少战争的世界,为天使们打开大门的世界。

或者,我们被机器的种种优点深深诱惑——无与伦比的运算速度、看上去非常完美以及近乎冷酷的精准,我们赋予机器强大的能力,相信机器可以毫不犹豫地正确执行分派的任务,寄望机器不会出错,程序代码不存在任何瑕疵,不会引发事故,或者不存在可被敌人利用的漏洞。

这些假设都没有容易的答案。

如果战争可以轻易避免,主权国家可以通过条约而不是武力来确保和平,人类早就会那么做了。

军事力量之所以存在,就是为了作为一种威慑工具应对那些不遵守国际法或国际美好愿望共识的人的。

让主权国家屈从于一种潜在工具来达到自我防卫的目的,无异于让他们进行一场危险的豪赌。

虽然如此——虽然现实是没有专门的警察来执行战争法,且只有胜利者才有资格决定谁应当受到审判。虽然现实是,只有最终的实力而非权利才有资格决定谁会在战场上获胜或死亡。

尽管如此,千百年来战争法则仍然影响了人们在战争中的行为。即便最古老的战争法则,也规定了哪些武器可以在战争中运用,哪些武器完全无法接受。

锋利的、蘸有毒药的箭头在战争中非常有用,但用它杀人是不人道的和错误的。

从历史上看,人类之间选择通过合作来避免战争中最坏的结果,采取措施限制出格的杀戮行为,甚至是在生死攸关的时刻。

有时这些合作会失败,但奇迹在于有些合作会取得成功。

进入现代阶段,虽然不是所有国家,但绝大多数国家的军队选择避免在战争中使用化学武器、激光致盲武器、地雷和集束炸弹。

世界有核国家已就限制部署核武器以促进全球战略稳定达成了共识。虽然这些规则或共识有时会遭致破坏,但各国间的自我克制还是得以维持,使我们对于世界和平的前景抱有希望。

这种自我克制——各国一旦失去自我克制,世界将变得十分危险——现在仍然必要。

如果有些国家执意要研发自主武器,任何纸上协议都将难以阻止。与此同时,相关国家进行混乱的军备竞赛而不清楚这场竞赛会将我们引向何方,这对哪个国家都没有好处。

各国必须共同合作,确定战争中的哪些领域应用自主武器是合适的,哪些领域不行,哪些地方需要将人类判断让渡给机器。

这些规则必须在保持人类决策重要性的同时,尝试利用自主性改进战争中的人类事务。

权衡人类决策对于自主武器干预的必要性,需要社会各领域的辩论,而不仅仅是学者、律师和职业军人的事。

社会大众的参与也是很必要的,毕竟军用自主机器人最终将在人类生活的空间广泛存在并执行各种任务。

机器能够做很多事情,但它们不能创造事物背后的意义。

他们难以为我们回答更多的隐含性问题。机器不能明白人类价值观,也不能告诉我们应该如何做出选择。

我们人类所创造的未来世界,将会有越来越多智能机器出现。

但是,这个世界不是为机器而存在的,这个多姿多彩的世界是为了人类而存在。

《无人军队:自主武器与未来战争》

作者:[美]保罗·沙瑞尔

译者:朱启超 王姝 龙坤

出版发行:世界知识出版社

出版时间:2019年6月

ISBN:978-7-5012-5902-1

定价:86.00元